Incrementality: cómo medir lo que realmente funciona en marketing

Introducción: el problema que nadie admite pero todos sufren

Si trabajas en marketing a nivel estratégico o táctico, reconocerás la sensación: estás invirtiendo recursos y tienes métricas que suben, pero no sabes cuánto de ese movimiento se debe realmente a tus acciones. No es una cuestión de negligencia, sino de complejidad. Los ecosistemas actuales combinan canales digitales y offline, efectos de marca acumulados, promociones y comportamiento estacional, y todo eso enmascara la verdadera contribución de cada iniciativa.

La incrementalidad aborda precisamente esa necesidad: responder a la pregunta causal esencial de si una acción hizo aumentar una métrica clave y en qué medida. No basta con observar mejoras en conversiones o clics; hay que aislar el efecto neto atribuible a la intervención. Esto requiere una mezcla de diseño experimental, fundamentos de inferencia causal y decisiones prácticas que se puedan ejecutar en entornos empresariales reales.

En esta guía te acompaño paso a paso. Hablaremos de conceptos teóricos imprescindibles, de cómo elegir y ejecutar diseños experimentales o quasiexperimentales, de errores habituales y de ejemplos concretos aplicables en publicidad digital, CRM y retail. Mi enfoque es didáctico y práctico: evitaré pedanterías y me centraré en lo que puedes aplicar desde mañana para mejorar la toma de decisiones en tu equipo.

Qué entendemos por incrementalidad

Incrementalidad es la medición del efecto adicional que una acción de marketing produce sobre una métrica relevante, comparada con lo que habría ocurrido si la acción no se hubiera ejecutado. Es un concepto causal: interesa la diferencia entre dos mundos alternativos, el con y el sin la intervención. Ese contraste hipotético es la esencia de cualquier evaluación robusta de impacto.

En términos operativos, medir incrementalidad exige construir un contrafactual razonable. Ese contrafactual puede obtenerse mediante aleatorización, usando grupos de control y tratamiento, o con métodos observacionales que intentan recrear ese estado alternativo. La clave está en asegurar que la única diferencia sistemática entre ambos grupos sea la exposición a la acción cuya incrementalidad queremos estimar.

La incrementalidad va más allá de la atribución tradicional que reparte crédito entre puntos de contacto. Mientras la atribución mejora el entendimiento de recorridos, la incrementalidad valida si esos recorridos habrían existido de todas formas. Este matiz es vital para asignar presupuesto con criterio y para priorizar iniciativas que generan verdadero valor incremental.

Fundamentos de causalidad aplicados al marketing

Medir incrementalidad no es una moda metodológica; es aplicar principios de inferencia causal al terreno del negocio. En la base están trabajos y marcos teóricos de investigadores como Donald Rubin y Judea Pearl, que nos recuerdan que correlación no es causalidad y que necesitamos diseños que permitan identificar efectos causales con validez.

El marco de potencial outcomes, desarrollado por Rubin y otros, plantea explícitamente la dificultad del contrafactual: para cada unidad (usuario, tienda, segmento) sólo observamos uno de los dos posibles estados. La solución clásica es la aleatorización, que distribuye de forma balanceada factores observados y no observados entre control y tratamiento, permitiendo estimar el efecto medio con sesgo reducido.

Judea Pearl, por su parte, aporta herramientas conceptuales para razonar sobre confusión, mediación e intervención mediante diagramas causales. En la práctica, estos marcos nos ayudan a decidir cuándo un experimento es indispensable y cuándo conviene invertir en métodos observacionales más sofisticados, como el uso de propensity scores o controles sintéticos.

Diseños de prueba: opciones y criterios de elección

Pruebas aleatorias controladas (RCTs) y pruebas AB

Las pruebas aleatorias son la referencia de calidad para medir incrementalidad. Al asignar aleatoriamente usuarios a grupos expuestos y no expuestos, minimizas la influencia de variables ocultas y obtienes una estimación limpia del efecto promedio. Esto funciona muy bien en entornos digitales donde el tráfico puede segmentarse de forma fiable.

Las pruebas AB son un caso particular de RCTs orientadas a comparar variantes creativas, mensajes o experiencias. Para medir incrementalidad, es habitual reservar un grupo de control no expuesto a la intervención comercial y comparar su comportamiento con el grupo tratado. La aleatorización debe implementarse con rigor para evitar sesgos operativos, por ejemplo por filtrado previo del tráfico o por solapamiento entre segmentos.

Antes de lanzar una prueba AB, valida que el proceso de randomización sea independiente del sistema de entrega y que no haya contaminación entre grupos. Además, define con claridad la métrica de impacto principal y limita las múltiples pruebas simultáneas que puedan generar interferencia entre experimentos.

Pruebas geográficas y por clúster

Cuando no es posible asignar usuarios de forma individual —por ejemplo en campañas offline o en estrategias cross-channel— las pruebas por geografía o por clúster son una alternativa sólida. Seleccionas territorios para control y tratamiento de manera que sean comparables en términos de comportamiento histórico y características socioeconómicas.

La ventaja de las pruebas geográficas es que reducen el riesgo de contaminación y permiten evaluar efectos a escala. Sin embargo, requieren un diseño cuidadoso de la selección de territorios y controles para evitar sesgos por diferencias locales. La aleatorización a nivel de clúster es más cara en términos de unidades observables, pero conserva la validez causal si se implementa correctamente.

Otro aspecto a considerar es la heterogeneidad de efecto entre territorios: incluso con buen diseño, es posible que la respuesta varíe por factores locales. Documentar estas diferencias y entender sus causas forma parte del aprendizaje que debe entregar una prueba bien diseñada.

Métodos observacionales y controles sintéticos

Cuando la aleatorización no es viable, existen métodos observacionales que intentan aproximar el contrafactual. Entre ellos, el emparejamiento por propensity score, la regresión con variables de control y los controles sintéticos merecen atención. Todos requieren asunciones explícitas sobre la ausencia de confusión no observada o sobre la especificación correcta del modelo.

El control sintético es útil cuando se dispone de series temporales ricas. Consiste en construir una combinación ponderada de unidades no tratadas que reproduzca el comportamiento preintervención de la unidad tratada. Si la recreación del periodo previo es buena, la divergencia posterior puede interpretarse como efecto del tratamiento con mayor confianza.

Debes ser honesto sobre las limitaciones de estos métodos. Ningún método observacional reemplaza una buena aleatorización, pero aplicados con rigor y diagnóstico apropiado, permiten estimaciones útiles allí donde el experimento no es posible o sería poco ético o demasiado costoso.

Implementación práctica paso a paso

Primero define la pregunta causal con precisión: qué acción vas a evaluar, sobre qué unidad de análisis y cuál es la métrica de impacto principal. Evita metas vagas. Por ejemplo: determinar el efecto incremental de una campaña display en nuevas conversiones mensuales atribuibles a usuarios únicos, en lugar de decir simplemente ‘aumentar el rendimiento’. Una pregunta bien formulada orienta el diseño y evita análisis perezosos.

Segundo, selecciona el diseño más adecuado: RCT si puedes randomizar; prueba geográfica si trabajas con tiendas; métodos observacionales si no hay alternativa. Para cada diseño define el periodo de medición, la ventana de atribución y las métricas secundarias que te permitirán interpretar efectos secundarios como cambios en el comportamiento de compra o en el ticket medio.

Tercero, prepara la instrumentación y el governance: asegúrate de que los sistemas de entrega respeten la asignación aleatoria, que las etiquetas y eventos se implementen con calidad y que existan mecanismos para monitorizar la integridad del experimento. Define roles: quién monitoriza, quién interrumpe si hay problemas y cómo se documentan desviaciones. Sin governance, incluso un diseño perfecto puede arruinarse en ejecución.

Decisiones sobre ventana temporal y métricas

Elegir la ventana temporal para medir el efecto es más estratégico de lo que parece. Algunas acciones generan impacto inmediato; otras tienen efectos diferidos que se manifiestan en semanas o meses. Si mides demasiado pronto puedes subestimar el efecto; si mides demasiado tarde, corres el riesgo de mezclar intervenciones sucesivas y perder claridad causal.

La elección de la métrica principal debería alinearse con el objetivo comercial: conversión, ingresos incrementales, margen, retención. Evita métricas de vanidad que no representen valor real para la empresa. Define además métricas secundarias que expliquen el mecanismo: tasa de clics, frecuencia de compra, tasa de repetición, coste por adquisición incremental.

Incluye en el diseño pruebas de robustez: estimaciones en subgrupos relevantes, análisis con y sin determinados segmentos, y tests de sensibilidad a la ventana. Estas comprobaciones aumentan la confianza en la interpretación y ayudan a identificar sesgos o efectos heterogéneos que cambian la decisión táctica.

Ejemplos prácticos aplicables desde ya

Publicidad digital: display y vídeo

Imagina que quieres medir cuánto incrementan las conversiones las campañas de display. La receta clásica es un RCT que excluya al grupo de control de la exposición a display durante el periodo. Controla que ambos grupos tengan acceso a otros canales y documenta su actividad para evitar interpretaciones erróneas. Al final compara conversiones por usuario o por cohorte entre control y tratamiento para obtener el lift incremental.

Si la plataforma publicitaria no permite un holdout perfecto, una alternativa práctica es segmentar por audiencia interna o por cookies gestionadas por tu DSP. Asegúrate de que estas segmentaciones no introduzcan sesgos demográficos o de comportamiento. Complementa con análisis de persistencia del efecto: ¿la exposición produjo compras inmediatas o aumentó la propensión a comprar en meses siguientes?

Documenta además el coste incremental por unidad de resultado y compáralo con otras alternativas de inversión. La incrementalidad sin contexto de coste es una señal incompleta: saber que algo genera valor es útil, pero más aún es saber si ese valor supera el coste de generarlo.

CRM y campañas de email

En CRM, la segmentación y la personalización dificultan la creación de grupos de control. Un enfoque práctico es reservar aleatoriamente un porcentaje de la base para no recibir la campaña y comparar su comportamiento con el del grupo tratado. Asegura que el holdout sea estable en el tiempo y que no afecte la experiencia de cliente de forma inesperada.

Considera además los efectos de exposición múltiple: muchos usuarios reciben comunicaciones recurrentes. Define reglas para tratar usuarios con historial de interacciones previas y para evitar confundir la respuesta a una campaña con la acumulación de exposiciones. Analiza la retención y el CLV incremental, no solo la conversión puntual.

Un error habitual en CRM es medir sólo aperturas o clics. Aunque son útiles, la métrica relevante para incrementalidad suele ser la conversión relevante o el valor generado. Diseña tus eventos y tu data pipeline pensando en estas métricas desde el inicio de la campaña.

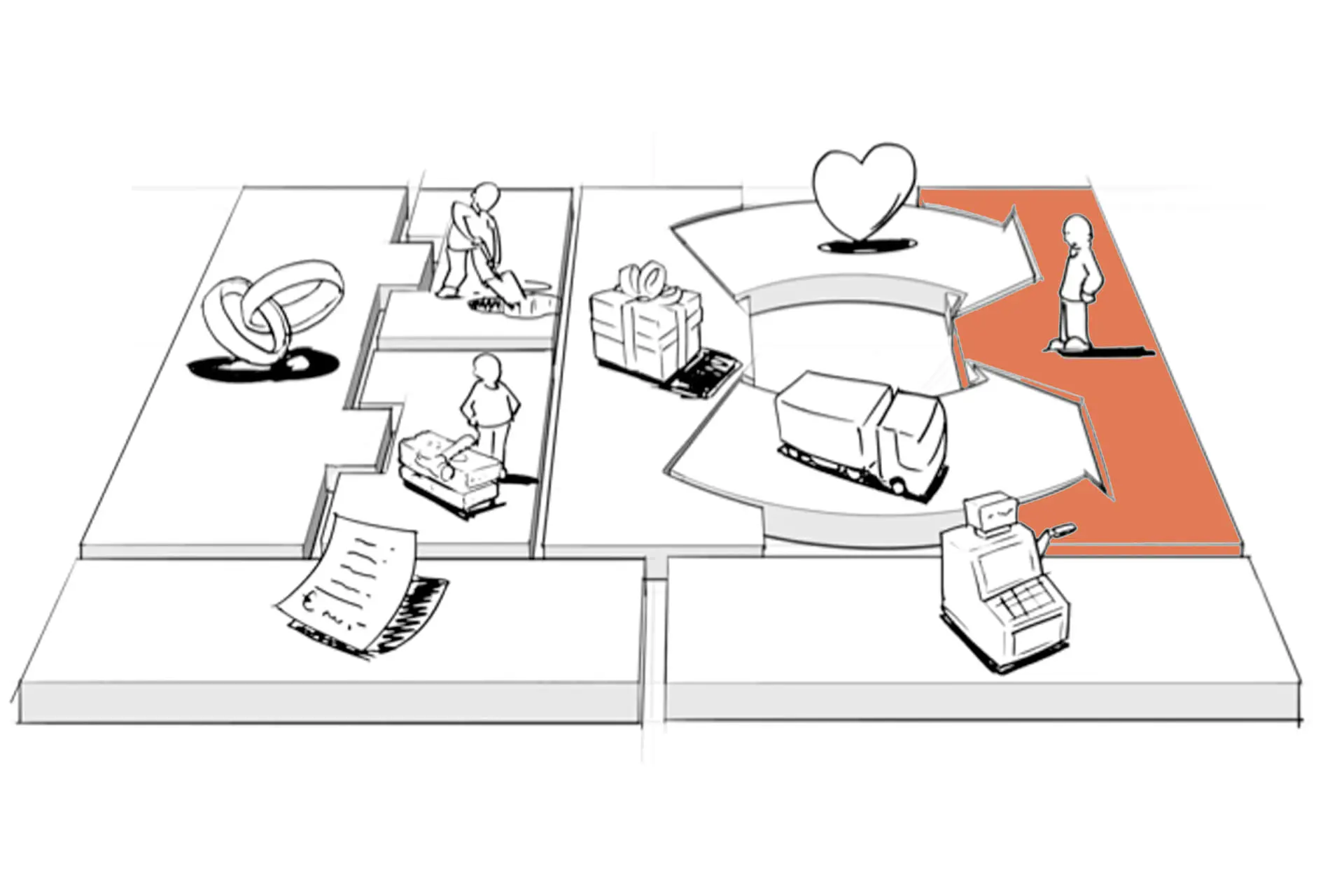

Promociones y retail

En entornos de tienda física, las pruebas geográficas y por tienda son la vía más realista. Selecciona tiendas pareadas o construye un control sintético a partir de tiendas que no reciben la promoción. Asegura que variables externas como estacionalidad o eventos locales se controlen mediante el emparejamiento o mediante controles temporales.

Las promociones suelen tener efectos sobre el mix de producto y la frecuencia de compra. Mide no sólo ventas totales, sino margen incremental y cannibalización entre referencias. A veces una promoción aumenta ventas pero reduce margen o desplaza compras que se habrían producido igualmente: medir incrementalidad es, en retail, fundamental para conocer el valor real de la promoción.

Finalmente, integra datos de POS con datos de marketing para vincular exposición y compra. La trazabilidad desde la planificación hasta las ventas reales es lo que convierte una prueba en aprendizaje accionable.

Riesgos, errores frecuentes y cómo evitarlos

Uno de los errores más frecuentes es diseñar el experimento sin pensar en la implementación operativa. Por ejemplo, olvidarse de excluir por completo al grupo de control o permitir que sistemas externos expongan a ese grupo a la intervención. La solución pasa por coordinar con ingeniería, partners y operaciones antes del lanzamiento.

Otro riesgo es la interferencia entre unidades, conocida en teoría causal como violación de SUTVA. Si la exposición de unos usuarios cambia el comportamiento de otros (por ejemplo por efecto de red o influencia social), la estimación del efecto promedio se complica. En estos casos, el diseño por clúster o los análisis que modelan la interferencia son más adecuados.

Finalmente, la tentación de analizar resultados demasiado pronto o de tomar decisiones basadas en múltiples comparaciones sin corrección puede llevar a conclusiones erróneas. Define con antelación criterios de éxito, controla el error tipo I y planifica análisis de potencia cuando sea posible. La disciplina estadística no es un adorno: protege la validez de tus decisiones.

Interpretación práctica y decisiones sobre presupuesto

Una vez estimado el efecto incremental, la decisión natural es cómo reorientar presupuesto. Aquí entra la economía del marketing: compara el beneficio incremental esperado con el coste de generar ese incremento. Esta comparación determina si una acción merece escala, repetición o abandono.

Además, utiliza la información de heterogeneidad de efectos para optimizar. Si ciertas audiencias responden mejor, redistribuye inversión hacia esas audiencias o personaliza creativos. La incrementalidad no sólo dice si algo funciona, también ayuda a saber dónde funciona mejor y por qué.

Integra los resultados de tus pruebas en ciclos de planificación. El objetivo no es testar por testar, sino construir un portafolio de iniciativas priorizado por impacto incremental y coste, que permita a tu organización invertir con criterio y aprender continuamente.

Cómo combinar incrementalidad con modelos de atribución y MMM

La incrementalidad complementa la atribución y los modelos de mix de marketing (MMM). Mientras la atribución distribuye crédito entre puntos de contacto y el MMM da visión agregada de contribuciones por canal, las pruebas de incrementalidad validan causalmente si una palanca realmente genera valor incremental.

Una práctica útil es usar incrementalidad para calibrar modelos: los resultados experimentales pueden servir como datos de referencia para ajustar parámetros en modelos observacionales o en MMM. Esta triangulación mejora la robustez de las estimaciones y reduce el riesgo de basar decisiones únicamente en modelos que no han sido validados con experimentos.

Recuerda que cada enfoque tiene su escala y su horizonte: las RCTs son prácticas para evaluar acciones puntuales y tácticas a nivel de usuario; el MMM sirve para decisiones estratégicas de asignación a largo plazo. La combinación bien diseñada ofrece lo mejor de ambos mundos.

Medición del aprendizaje y documentación

Documenta cada experimento con rigor: hipótesis, diseño, asignación, periodo, métricas, resultados y lecciones aprendidas. Esta documentación alimenta un repositorio de pruebas que facilita replicación y aprendizaje organizacional. Sin registro, el conocimiento se dispersa y se vuelve difícil de reaplicar.

Incluye también análisis cualitativos que expliquen los mecanismos detrás del efecto medido. Las cifras son cruciales, pero comprender por qué una acción funcionó ayuda a transferir aprendizajes a otras campañas y contextos. Entrevistas con equipos de ventas, análisis de creatividades o estudio de feedback de clientes complementan el cuadro.

Finalmente, promueve una cultura donde fallar bien es aceptado: un experimento que muestra ausencia de efecto es tan valioso como uno que muestra efecto, siempre que aporte aprendizaje claro. La incrementalidad no es sólo control de gasto: es una herramienta para aprender más rápido y gastar mejor.

Conclusión: de la evidencia a la decisión

Medir incrementalidad es indispensable para quienes buscan decisiones de marketing basadas en evidencia y orientadas al valor. No se trata solo de medir por medir, sino de estructurar la medición para que responda preguntas relevantes y accionables. Con buenos diseños, instrumentación rigurosa y un enfoque causal puedes distinguir lo que realmente aporta valor de lo que solo parece hacerlo.

Combina experimentación cuando sea posible, métodos observacionales cuando no lo sea, y siempre documenta y comparte el aprendizaje. La integración entre pruebas, modelos y gobernanza permitirá a tu organización desplegar presupuesto con más criterio y menos intuición, mejorando la eficiencia y el impacto del marketing.

Si algo quiero que te lleves de esta guía: la incrementalidad exige disciplina, pero los resultados son transformadores. Mide lo que importa, diseña con atención y usa los resultados para priorizar. Con ese enfoque, pasarás de optimizar métricas de vanidad a generar verdadero valor incremental para la empresa.

Referencias

• Pearl J. (2009). Causality: Models, Reasoning, and Inference. Cambridge University Press.

• Rubin D. B. (1974). Estimating causal effects of treatments in randomized and nonrandomized studies. Publicaciones sobre marco de resultados potenciales.

• Rosenbaum P. R., & Rubin D. B. (1983). The central role of the propensity score in observational studies for causal effects. Biometrika.

• Hernán M. A., & Robins J. M. (2020). Causal Inference: What If. Chapman & Hall/CRC.

• Binet L., & Field P. (2013). The Long and the Short of It. Institute of Practitioners in Advertising.

• Sharp B. (2010). How Brands Grow. Oxford University Press.

• Kotler P., & Keller K. L. (2016). Marketing Management. Pearson.